반응형

9.1 인공신경망의 이해

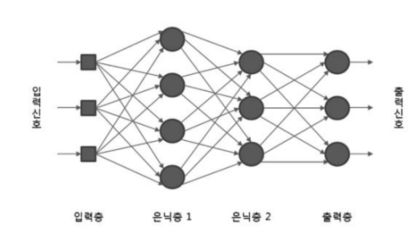

9.1.1 인공신경망의 구조와 구성요소

- 인공신경망은 인간의 뇌를 본따서 ㅁ나들어짐

- 뇌의 뉴런들은 수상돌기를 통해 다른 뉴런들로부터 입력신호를 받아들이고 변환과정을 수행한 후에 축삭돌기를 이용해 다른 뉴런에 전달

- 인공신경망에서는 노드가 뉴런과 같은 역할을 함

- 여러 노드에서 값을 받아 가중합을 계산하고 활성화 함수를 적용해서 값을 변환한 후 다음 노드로 전달

9.1.2 인공신경망에서의 학습

- 학습: 주어진 학습 데이터를 이용해 올바른 가중치를 찾아가는, 조정하는 과정

- 인공신경망은 입력값들에 대해 목표 출력값 혹은 실제 출력값을 매칭시킨 학습자료를 이용해서, 주어진 입력값에 대해 매칭되는 출력값을 예측할 수 있도록 가중치를 조정하는 지도학습 사용

9.1.3 손실함수의 이해

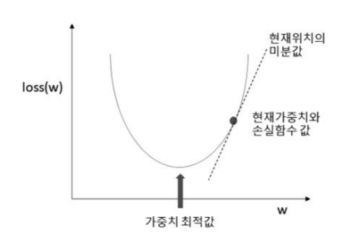

- 손실 함수: 현재 예측한 출력값 집합과 실제 출력값 집합 사이에 얼마나 오차가 있는지 하나의 값으로 나타내는 함수

- 딥러닝에서 복잡한 문제를 해결하려고 할 때 손실 함수에 적절한 요소를 추가함으로써 학습의 방향 결정 가능

- MSE(Mean Squared Error): 가장 기초적인 손실 함수로 예측된 값과 실젯값 간의 에러를 제곱해 평균을 계산한 평균 제곱오차

- binary cross entropy: 감성분석과 같은 이진 분류가 목표일 때 사용

- cross entropy: 문서 분류와 같이 다중 분류가 목표일 때 사용

9.1.4 경사하강법

- 경사하강법: 학습에서 최적의 가중치를 찾아나가기 위한 방법론

9.2 딥러닝의 이해

9.2.1 딥러닝이란?

- 층이 깊은 인공신경망을 사용하는 기계학습 알고리즘

9.2.2 층이 깊은 신경망의 문제점

- 은닉층이 많으면 학습이 잘 이루어지지 않음

- 경사소실(vanishing gradient): 역전파 과정에서 점차 기울기가 사라져서 학습이 전혀 이루어지지 않음

9.2.3 딥러닝에서의 해결방안

- 경사소실로 인해 학습이 잘 안되는 현상을 극복하기 위해 RBM(Restricted Boltzmann Machine)과 같은 사전학습을 통해 가중치들을 단계별로 먼저 학습시키거나, 시그모이드 함수 대신 ReLU와 같이 계산량이 적고, 경사소실이 없는 활성화 함수 개발

- ReLU와 같은 새로운 비선형 활성화 함수 이용 경사소실 문제 완화

- 사전학습을 통해 깊은 층에서의 학습 효과 향상

- GPGPU를 이용한 연산속도의 향상

- CNN과 같이 주어진 문제에 맞는 효과적인 딥러닝 모형의 개발

9.2.4 다양한 딥러닝 알고리즘

- CNN

- RNN

- RBM

- DBN

- Deep Q-Network

- GAN

- BERT

- GPT

9.2.5 딥러닝 개발 및 활용환경

- 텐서플로

- 파이토치

※ 해당 내용은 <파이썬 텍스트 마이닝 완벽 가이드>의 내용을 토대로 학습하며 정리한 내용입니다.

반응형

'텍스트 마이닝' 카테고리의 다른 글

| RNN-딥러닝을 이용한 문서 분류 (2) (0) | 2023.07.21 |

|---|---|

| RNN-딥러닝을 이용한 문서 분류 (1) (0) | 2023.07.20 |

| 감성 분석 (3) (0) | 2023.07.18 |

| 감성 분석 (2) (0) | 2023.07.17 |

| 감성 분석 (1) (0) | 2023.07.16 |