반응형

4-1 초기 인공지능 알고리즘과 로지스틱 회귀

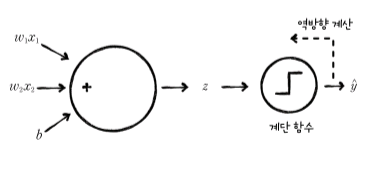

- 퍼셉트론

마지막 단계에서 샘풀을 이진 분류하기 위하여 계단함수를 사용

- 아달린

적응형 선형 뉴런

-로지스틱 회귀

마지막 단계에서 임계 함수를 사용하여 예측을 수행

4-2 시그모이드 함수로 확률 만들기

- 시그모이드 함수

출력값z를 0~1 사이의 확률값으로 변화시켜주는 역할로, 시그모이드를 통과한 값 a가 0.5 이상이면 양성 클래스, 이하면 음성 클래스

- 오즈 비(odds ratio)

성공 확률과 실패 확률의 비율을 나타내는 통계

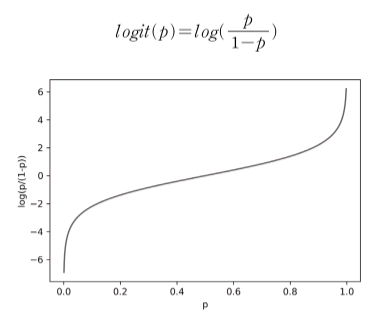

- 로짓 함수(logit function)

오즈 비에 로그 함수를 취하여 만든 함수

- 로지스틱 함수

시그모이드 함수

- 로지스틱 회귀 정리

반응형

4-3 로지스틱 손실 함수 경사 하강법에 적용

로지스틱 회귀와 같은 분류의 목표는 올바르게 분류된 샘플 데이터의 비율 자체를 높이는 것

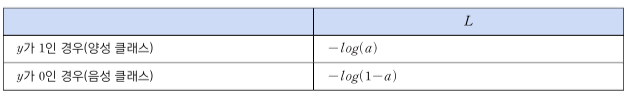

- 로지스틱 손실 함수

L = -(ylog(a) + (1-y)log(1-a))

a = 활성화 함수가 출력한 값, y = 타킷

- 로지스틱 손실 함수 미분

- 로지스틱 손실 함수와 연쇄 법칙

- 로지스틱 손실 함수의 미분 과정 정리, 역전파

※ 해당 내용은 <Do it! 딥러닝 입문>의 내용을 토대로 학습하며 정리한 내용입니다.

반응형

'딥러닝 학습' 카테고리의 다른 글

| 4장 분류하는 뉴런 만들기-이진분류 (3) (0) | 2023.03.05 |

|---|---|

| 4장 분류하는 뉴런 만들기-이진 분류 (2) (0) | 2023.03.04 |

| 3장 머신러닝 기초 다지기-수치 예측 (2) (0) | 2023.03.02 |

| 3장 머신러닝 기초 다지기-수치 예측 (1) (0) | 2023.03.01 |

| 2장 최소한의 도구로 딥러닝 시작 (0) | 2023.02.28 |